Prompt> GPT-5 e la lungimiranza

La rubrica di Nello Cristianini per spiegare in ogni episodio i concetti chiave del dibattito sulla tecnologia da cui dipende il nostro futuro

Immaginate di guidare da casa al lavoro e di voler selezionare il percorso più breve o più veloce. Non basta fare la scelta migliore a ogni svolta: a volte è necessario fare un piccolo sacrificio all'inizio, per ottenere vantaggi in seguito

Nello Cristianini

Buongiorno a tutte e tutti e buon 25 aprile,

vedremo quali parole di rito oggi ci saranno - o mancheranno - e quali inevitabili polemiche riempiranno i giornali di domani.

Ho sfogliato un libro di Norberto Bobbio nel quale cerco qualche idea ogni anno di questi tempi, Eravamo ridiventati uomini - Testimonianze e discorsi sulla resistenza (Einaudi).

Col passare del tempo, in ciascuno dei testi raccolti, Bobbio si fa più sconfortato e cupo. La memoria di cos’è stata la resistenza non regge agli urti dell’attualità, della polemica contingente che ha bisogno di cancellare sfumature, complessità.

Quasi sfinito, nell’ultimo testo del 1999, il grande filosofo chiede che almeno una cosa sia ricordata, se proprio deve rimanere almeno un nucleo di consapevolezza, che sia questo:

“La Resistenza italiana è stata una parte della Resistenza europea. Uno dei meriti storici della Resistenza italiana, che non dobbiamo dimenticare, e che nessun revisionismo storico di sinistra o di destra può mettere in discussione, è stato quello di aver portato l’Italia, dopo vent’anni di ditatura, nel seno delle nazioni civili, e di averle restituito ad un tempo la libertà dallo straniero e la democrazia nel nostro paese”.

Direi che mentre si avvicinano le elezioni europee di giugno, ricordare questa continuità tra resistenza, Costituzione ed Europa sia il modo migliore per evitare di essere risucchiati nel gorgo delle polemiche e per non perdere di vista la vera eredità di lungo periodo del 25 aprile. Un’eredità che la presidente del Consiglio e molti esponenti della maggioranza di governo non si sentono di rivendicare, ma resta la base su cui è costruita non solo l’Italia ma anche l’Europa.

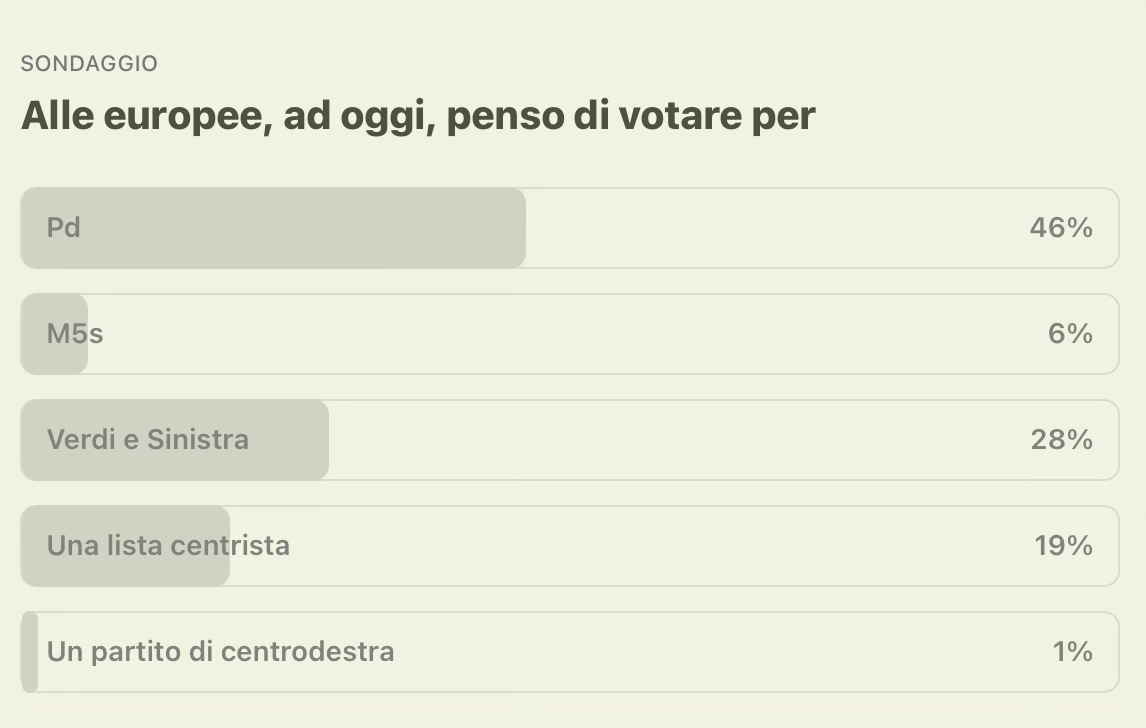

Intanto vi anticipo qui i primi risultati del sondaggio tra gli abbonati di Appunti su cosa votare alle europee di giugno, viste le perplessità che suscita (non solo in me, pare) il Pd di Elly Schlein.

Se volete partecipare, trovate il sondaggio all’interno di questo pezzo:

Oggi vi lascio al nuovo appuntamento con la sempre più indispensabile rubrica Prompt di Nello Cristianini, che con una capacità divulgativa unica ci porta nel dibattito sull’intelligenza artificiale (se avete tempo in questi giorni di ponti vacanzieri, leggete il suo nuovo libro Machina Sapiens).

Buon 25 aprile,

Stefano

Prompt> GPT-5 e la lungimiranza

di Nello Cristianini

Lo scorso novembre, durante il breve licenziamento di Sam Altman da OpenAI, Reuters aveva parlato di una misteriosa email, mandata a tutto il personale dalla dirigente Mira Murati, per avvisarli di possibili storie nei media riguardo un nuovo algoritmo chiamato Q* (q-star).

In un articolo, Reuters speculò che questo potesse essere un passo avanti verso una forma di AGI (intelligenza artificiale generale), legato alla capacità di risolvere problemi matematici, e non solo linguistici.

Non si è mai saputo chiaramente cosa fosse quell’algoritmo, ma tra qualche settimana potremmo vedere un nuovo livello di intelligenza artificiale, almeno se prendiamo seriamente le dichiarazioni di OpenAI e Meta, sulle caratteristiche di GPT-5 e Llama 3, i nuovi modelli di linguaggio ormai pronti a essere rilasciati nelle prossime settimane (due versioni ridotte di Llama 3 sono già uscite, quella principale è ancora in collaudo, così come GPT-5). Questa volta la differenza potrebbe dipendere non (solo) dalle dimensioni, ma da una nuova capacità: quella di pianificare.

Per capire quelle anticipazioni, andiamo con ordine, perche’ c’e’ bisogno di alcuni termini tecnici.

Modelli di linguaggio. Al centro di un modello di linguaggio (LLM) come GPT-4 c'è la capacità di generare le parole mancanti in un testo, tipicamente la prossima parola in una frase troncata: grazie a questa possiamo generare testi molto lunghi, semplicemente “iterando”, ovvero ripetendo questo passo molte volte (processo chiamato in gergo “autoregressivo”).

Ma non è detto che concatenando insieme tutte le parole che sembrano migliori al momento si ottenga la migliore risposta.

Infatti una strategia di questo tipo potrebbe spingere l’algoritmo in un angolo da cui è difficile uscire.

E’ qui che la capacità di pianificare diventa utile, un vecchio tema dell’AI classica, da non confondere con i metodi moderni.

Pianificare. Ecco un esempio più familiare. Immaginate di guidare da casa al lavoro e di voler selezionare il percorso migliore, ovvero la sequenza di scelte che è complessivamente ottimale in un certo senso, ad esempio costi o tempi.

Non basta fare la scelta migliore a ogni svolta: a volte è necessario fare un piccolo sacrificio all'inizio, per ottenere qualche vantaggio in seguito, come quando ci si mette in fila per entrare in autostrada, perché questo ci permetterà di muoverci più velocemente in seguito.

Situazioni simili emergono nel gioco degli scacchi (sacrificare un pezzo ora per avere una vittoria dopo), o nella soluzione di espressioni matematiche (tra tutte le trasformazioni possibili, quale e’ quella che mi condurra’ alla soluzione desiderata ?).

AlphaGo nel 2016 aveva introdotto un approccio innovativo proprio a questo problema, imparando dall’esperienza (anche) a pianificare.

Combinare in modo non banale le capacità di AlphaGo con quelle dei modelli come GPT, in modo che possano apprendere a pianificare le proprie azioni, è stato da tempo uno degli obiettivi dei ricercatori.

I limiti di GPT. GPT, Gemini e gli altri modelli linguistici di grandi dimensioni hanno avuto difficoltà: progettati per prevedere la parola successiva per una determinata sequenza di parole, in realtà sono utilizzati per prevedere un'intera lunga serie di parole, e questo metodo puo’ mettere i modelli nei guai.

Talvolta chiediamo loro di rileggere e giudicare la propria frase precedente, e questi ci dicono “quella frase è falsa”. Sarebbe stato meglio se lo avessero scoperto prima di generarla. A me piace chiamare questa abilità “lungimiranza” (ma non è un termine tecnico).

Il problema tecnico è quello di ottenere questa capacità senza abbandonare il metodo delle reti neurali, perché è questo che consente all’AI moderna di imparare da enormi quantità di dati e sperimentazione, come nel caso di AlphaGo.

E’ proprio questo il problema che forse sara’ risolto nella prossima versione di GPT in arrivo quest'estate, e non pensiamo che si tratti solo di rispondere meglio alle domande: una migliore capacità di pianificare aiuterebbe gli stessi modelli anche a risolvere problemi matematici, tra le altre cose.

GPT-5 e Llama3. Pochi giorni fa, il Financial Times ha riportato i commenti dei dirigenti di Meta e OpenAI riguardo alle prossime versioni.

“Siamo al lavoro per capire come far sì che questi modelli non solo parlino, ma effettivamente ragionino, pianifichino … abbiano memoria”, ha affermato Joelle Pineau, vicepresidente della ricerca sull’intelligenza artificiale presso Meta.

Il chief operating officer di OpenAI, Brad Lightcap, ha detto al Financial Times che: “Stiamo iniziando a vedere AIs che possono risolvere compiti piu' complessi in un modo più sofisticato, penso che stiamo appena iniziando a scalfire la superficie delle capacità che questi modelli hanno di ragionare".

Questi annunci hanno fatto ripensare i ricercatori al dramma di novembre di OpenAI, quando si era parlato del misterioso algoritmo Q*, un nome che era suonato subito molto familiare agli informatici, perché riecheggiava i nomi di alcuni metodi esistenti per la pianificazione.

All'epoca, commentando quelle voci, il responsabile dell’intelligenza artificiale per Meta, Yann LeCun, aveva immediatamente twittato:

“Una delle sfide principali per migliorare l’affidabilità LLM è sostituire la previsione auto-regressiva di token con la pianificazione. Praticamente tutti i migliori laboratori (FAIR, DeepMind, OpenAI ecc.) ci stanno lavorando e alcuni hanno già pubblicato idee e risultati. È probabile che Q* sia un tentativo di pianificazione di OpenAI.”

Insomma, anche se le aziende stanno mantenendo il segreto sulle caratteristiche dei loro nuovi prodotti, le indicazioni sono che si sta lavorando sulla capacità di pianificare, ovvero di essere più lungimiranti nel proprio comportamento, un’abilità che avrebbe conseguenze anche nel completare ragionamenti, compiti matematici, e forse anche conversazioni complesse come i negoziati.

Nello Cristianini è autore di Machina sapiens. L'algoritmo che ci ha rubato il segreto della conoscenza (Il Mulino 2024)

Per seguirlo sui social: LinkedIn ; Instagram; Facebook

Nello Cristianini è professore di Intelligenza Artificiale all’Università di Bath, autore del volume La scorciatoia (Il Mulino, 2023), e di una serie di saggi e articoli specialistici sul tema dell’intelligenza artificiale, apprendimento automatico, analisi del linguaggio, conseguenze sociali dell’adozione delle tecnologie intelligenti.

Il mio nuovo libro: Dieci rivoluzioni

C’è il mio nuovo libro lo trovate qui. E ne ho scritto qui.

Se volete vedere la presentazione a Quante storie, il programma di Rai3 condotto da Giorgio Zanchini, cliccate qui sotto: è su RaiPlay.

Appunti è possibile grazie al sostegno delle abbonate e degli abbonati. E’ con il loro contributo che Appunti può crescere e svilupparsi anche con progetti ambiziosi come La Confessione. Se pensi che quello che facciamo è importante, regala un abbonamento a qualcuno a cui tieni.

Il Podcast: La Confessione

Ascolta La Confessione, il podcast di inchiesta che rivela per la prima volta da dentro come funziona il sistema di copertura e insabbiamento degli abusi sessuali nella Chiesa cattolica italiana.

Un podcast realizzato da Stefano Feltri, Giorgio Meletti e Federica Tourn, realizzato grazie al sostegno della comunità di Appunti. Con la collaborazione di Carmelo Rosa e la consulenza per musiche ed effetti di Stefano Tumiati.

Mi sembra di capire che sarà uno spreco di risorse ancora più grande, che pagheremo tutti ma in maniera non riconoscibile.